Inhaltsverzeichnis

Mit fortschrittlichen großen Sprachmodellen wie ChatGPT oder Gemini verschwimmt die Grenze zwischen menschlichem und maschinellem Schreiben mehr denn je.

Wie kannst du also erkennen, ob ein bestimmter Inhalt von einer KI generiert wurde, und wie zuverlässig ist diese Erkennung überhaupt?

In diesem Artikel untersuchen wir die Anzeichen, die dir helfen können, KI-Inhalte zu identifizieren, und sprechen über deren Zuverlässigkeit.

Sind ChatGPT-Texte erkennbar?

Ja, es gibt bestimmte Indikatoren, die darauf hindeuten könnten, dass ein Text von ChatGPT generiert wurde. Dies mit absoluter Sicherheit festzustellen, ist jedoch extrem schwierig.

Tatsächlich haben Studien gezeigt, dass selbst geschulte Pädagogen manchmal falsch einschätzen, ob die Arbeit von Schülern KI-generiert ist oder nicht. Das beweist eindrucksvoll, dass trotz vorhandener Hinweise die menschliche Fähigkeit, KI-Texte zu erkennen, alles andere als perfekt ist.

Eine der größten Herausforderungen besteht darin, dass man die Ausgaben von ChatGPT leicht bearbeiten kann, um sie unauffälliger zu machen. Ein paar kleine Änderungen an Formulierung, Tonfall oder Struktur können KI-generierte Inhalte viel menschlicher wirken lassen, sodass sie nahtlos mit anderen Texten verschmelzen.

Ein weiterer erschwerender Faktor ist die Variabilität in den Antworten von ChatGPT. Je nach Eingabe (Prompt) kann die KI Inhalte generieren, die von sehr generisch bis erstaunlich nuanciert reichen. Das macht es nahezu unmöglich, konsistente und wasserdichte Regeln für die Erkennung aufzustellen.

Letztendlich kann man zwar fundierte Vermutungen anstellen, ob ein Inhalt KI-generiert ist, aber man kann sich nie zu 100 % sicher sein. Es gibt Tools, die bei der Erkennung helfen, doch auch diese stoßen oft an ihre Grenzen.

Anzeichen für ChatGPT-generierte Texte

Auch wenn die Erkennung von ChatGPT-Inhalten schwierig ist, gibt es dennoch einige Anzeichen, die es wahrscheinlicher machen, dass ein Text von einer KI stammt:

1) Vorhersehbare KI-Strukturen

Selbst wenn sich der Wortlaut ändert, bleibt das zugrunde liegende Gerüst oft gleich. Sobald du dein Auge darauf geschult hast, erkennst du es in Sekunden.

Repetitive Satzlänge und -rhythmus

Sätze sind tendenziell in Länge und Komplexität sehr ähnlich.

Lies einen Abschnitt einfach mal laut vor. Bemerkst du einen stetigen, fast schon metronomischen Rhythmus?

Reiht sich Satz sauber an Satz, ohne kurze Unterbrechungen oder lange, etwas chaotische Umwege?

Menschliche Autoren machen das nicht durchgehend. Man macht Pausen. Man beeilt sich. Man betont. Man unterbricht den eigenen Redefluss, wenn einem mitten im Satz ein neuer Gedanke kommt. KI tut das nur extrem selten.

Absätze aus identischen Gussformen

Ein weiteres starkes Signal ist die Einheitlichkeit von Absätzen.

KI-Absätze folgen oft demselben internen Rezept:

- Einleitungssatz, der die Überschrift mehr oder weniger wiederholt

- Erklärung in neutralen Worten

- Unterstützender Satz, der wenig bis keine neuen Informationen hinzufügt

- Sanfter Schlusssatz, der zum nächsten Gedanken überleitet

Und jetzt wiederhole diese exakte Struktur fünfmal hintereinander.

An einem einzelnen Absatz ist absolut nichts falsch. Das Problem ist die Häufung. Menschliches Schreiben variiert deutlich stärker, weil Menschen nicht in sauberen, standardisierten Blöcken denken. Wir erforschen, schweifen ab, lenken zurück oder zoomen unerwartet ins Detail.

Übermäßige Verwendung von Gedankenstrichen

KI liebt:

- Gedankenstriche zur Betonung – wie diese hier – und das immer und immer wieder

- Sehr sorgfältig (und übermäßig korrekt) gesetzte Kommas

- Klammerzusätze, die sich fast immer unnötig anfühlen

Wie gesagt, ein einzelner Gedankenstrich bedeutet gar nichts. Zehn Gedankenstriche, die im selben Artikel rhetorisch genau gleich eingesetzt werden, sind ein starkes Indiz.

Wiederholte Schlussfolgerungen und „doppelte Verpackung“

Eines der deutlichsten strukturellen Anzeichen findet sich meist am Ende eines Textes.

KI macht häufig Folgendes:

- Schließt den Artikel mit einem Fazit ab

- Fasst dieses Fazit dann im nächsten Satz noch einmal zusammen

- Fügt dann noch „Kernaussagen“ hinzu, die beides erneut wiederholen

Du siehst dann oft Phrasen wie:

- „Zusammenfassend lässt sich sagen…“

- „Abschließend…“

- „Letztendlich…“

- Gefolgt von Aufzählungspunkten, die inhaltlich absolut identisch sind

Das passiert, weil die KI darauf trainiert ist, hilfreich und sicher zu sein. Sie möchte auf jeden Fall sicherstellen, dass du nichts verpasst hast. Menschen hören normalerweise auf zu reden, wenn der Punkt bereits gemacht wurde.

Dekorative Analogien

KI verwendet viele Analogien. Viel zu viele.

Besonders Analogien, die:

- Etwas erklären, das ohnehin schon offensichtlich und simpel ist

- Keinerlei neue Erkenntnisse bringen

- Ersatzlos gestrichen werden könnten, ohne die Bedeutung zu verändern

Zum Beispiel der Vergleich von Content-Strategie mit dem „Bau eines Hauses“ oder der „Navigation durch eine komplexe Landschaft“, ohne die Analogie im weiteren Text sinnvoll zu erweitern oder aufzulösen.

2) Repetitive KI-Formulierungen

Wenn du viele KI-gestützte Inhalte liest, wird dir schnell auffallen, dass bei völlig verschiedenen Themen immer wieder dieselben Formulierungen auftauchen.

„Nicht nur… sondern auch…“

Eine der häufigsten KI-Formulierungen ist der symmetrische Satzbau.

Beispiele, die du oft sehen wirst:

- „X verbessert nicht nur Y, sondern fördert auch Z.“

- „Egal, ob Sie Anfänger oder ein erfahrener Profi sind…“

- „Sowohl A als auch B spielen eine entscheidende Rolle bei…“

Diese Konstruktionen klingen wunderbar geschliffen. Und genau das ist das Problem.

Menschen verwenden sie gelegentlich, meistens zur besonderen Hervorhebung. Die KI verwendet sie als absoluten Standard, weil sie sicher und grammatikalisch unangreifbar sind. Wenn du sie mehrmals in einem einzigen Artikel siehst, ist das selten ein Zufall.

Trikola (Dreierlisten)

KI liebt Aufzählungen aus drei Dingen.

Du wirst Sätze lesen wie:

- „Klar, prägnant und effektiv“

- „Schneller, intelligenter und skalierbarer“

- „Genau, zuverlässig und umsetzbar“

Auch hier ist an sich nichts falsch daran. Das Problem ist nur die hohe Dichte solcher Konstruktionen.

Übermäßige Wegweiser und „führende“ Sprache

KI ist sehr höflich. Um genau zu sein, viel zu höflich.

Sie sagt dir andauernd, was sie als Nächstes tun wird:

- „Lass uns das genauer betrachten…“

- „Lass uns das mal aufschlüsseln…“

- „Lass uns nun erkunden…“

- „Hier ist der Grund, warum das wichtig ist…“

In Maßen ist diese Art von strukturierender Sprache nützlich. Aber die KI übertreibt es schlichtweg, weil sie darauf trainiert ist, immer extrem explizit und instruktiv zu sein.

Ausgewogene Sätze, die Festlegungen vermeiden

Ein weiterer verräterischer Hinweis ist die übertriebene Ausgewogenheit der Argumente.

KI neigt extrem zur Absicherung:

- „Während X seine Vorteile hat, bringt es auch Herausforderungen mit sich.“

- „Dieser Ansatz kann in einigen Fällen effektiv sein, in anderen jedoch nicht.“

- „Es gibt keine Universallösung.“

Diese Sätze sind technisch gesehen wahr. Sie sind aber auch völlig inhaltsleer, wenn ihnen kein eigener, klarer Standpunkt folgt.

Menschen haben in der Regel eine Meinung, selbst eine vorsichtige. Wir sagen klipp und klar, was wir tun würden. Wir sagen, was wir nicht tun würden. Die KI zieht die Neutralität vor, weil Neutralität schlichtweg sicherer ist.

3) Typisches KI-Vokabular

Beim Vokabular fangen die meisten Leute an, wenn sie versuchen, KI-Texte zu erkennen.

Das Problem ist nicht, dass die KI *schlechte* Wörter benutzt. Sie benutzt vielmehr **Standardwörter**. Sichere, flexible und kontextunabhängige Sprache, die buchstäblich fast überall passt.

„Bullshit“-Wörter (Floskeln)

KI wird an gigantischen Textkorpora trainiert. Daher bevorzugt sie naturgemäß ein Vokabular, das branchen-, themen- und stilübergreifend reibungslos funktioniert.

Wörter wie:

- Gamechanger

- Entscheidend

- Transformativ

- Innovativ

- Leistungsstark

Diese Wörter klingen furchtbar beeindruckend, zwingen den Autor aber so gut wie nie, sich inhaltlich auf etwas Konkretes festzulegen.

Standardphrasen

Manche Phrasen tauchen in KI-Texten so extrem oft auf, dass sie fast schon als finaler Beweis gelten können.

Beispiele, denen du mit großem Misstrauen begegnen solltest:

- „In der heutigen schnelllebigen Welt…“

- „Es ist wichtig zu beachten, dass…“

- „Seien wir mal ehrlich…“

- „Stell dir ein Szenario vor, in dem…“

- „Am Ende des Tages…“

Abstraktes Vokabular

KI liebt fiktive, abstrakte Orte:

- Die Landschaft

- Das Reich

- Das Ökosystem

- Der Raum

Diese Wörter erlauben es dem Modell wunderbar, locker um ein Thema herumzureden, ohne es jemals zu konkretisieren.

Zum Beispiel:

„In der sich ständig weiterentwickelnden Content-Marketing-Landschaft…“

Das klingt zwar toll, vermeidet aber jegliche Details. Welcher Teil des Content Marketings ist gemeint? B2B? SEO-Blogs? Produktdokumentationen? Agentur-Workflows?

Geschliffene, aber emotional neutrale Sprache

Ein weiteres typisches Vokabularsignal ist die tiefgreifende emotionale Flachheit.

KI vermeidet konsequent:

- Leichte Frustration

- Zweifel

- Reibung

- Bedauern

- Eine wirklich starke Präferenz

Stattdessen verwendet sie stets höfliche, gefällige Formulierungen:

- Effektiv

- Hilfreich

- Wertvoll

- Nützlich

- Erwägenswert

Dies erzeugt unweigerlich Texte, die zwar absolut unverfänglich, aber extrem distanziert und unpersönlich wirken.

4) Mangel an eigener Meinung und gelebter Erfahrung

KI-generierte Inhalte sind im weiten Sinne fast immer sachlich korrekt. Das Problem ist, dass sie sich stets in einer allzu sicheren Entfernung zur harten Realität bewegen.

Du wirst oft Aussagen finden wie:

- „Es ist wichtig, sich auf qualitativ hochwertige Inhalte zu konzentrieren.“

- „Konsistenz spielt eine Schlüsselrolle für den langfristigen Erfolg.“

- „Es ist essenziell, sein Publikum gut zu verstehen.“

All diese Aussagen sind absolut wahr. Aber keine einzige davon hilft dir wirklich dabei, eine konkrete Entscheidung zu treffen.

Ein weiteres starkes Signal ist die grammatikalische Distanz.

KI vermeidet sehr oft Formulierungen wie:

- „Ich habe versucht…“

- „Wir mussten das leider auf die harte Tour lernen…“

- „Wenn du X tust, wirst du unweigerlich auf Problem Y stoßen.“

Stattdessen verlässt sie sich voll und ganz auf passive oder verallgemeinernde Konstruktionen:

- „Es kann von Vorteil sein, zu…“

- „Unternehmen sollten in Betracht ziehen…“

- „Ein möglicher Ansatz besteht darin, zu…“

KI liefert zwar gerne Beispiele, aber diese sind oft eher illustrativ und fiktiv als real aus dem Leben gegriffen.

„Stell dir ein Unternehmen vor, das neue KI-Tools implementiert und dadurch eine verbesserte Effizienz feststellt.“

Sind KI-Detektoren überhaupt zuverlässig?

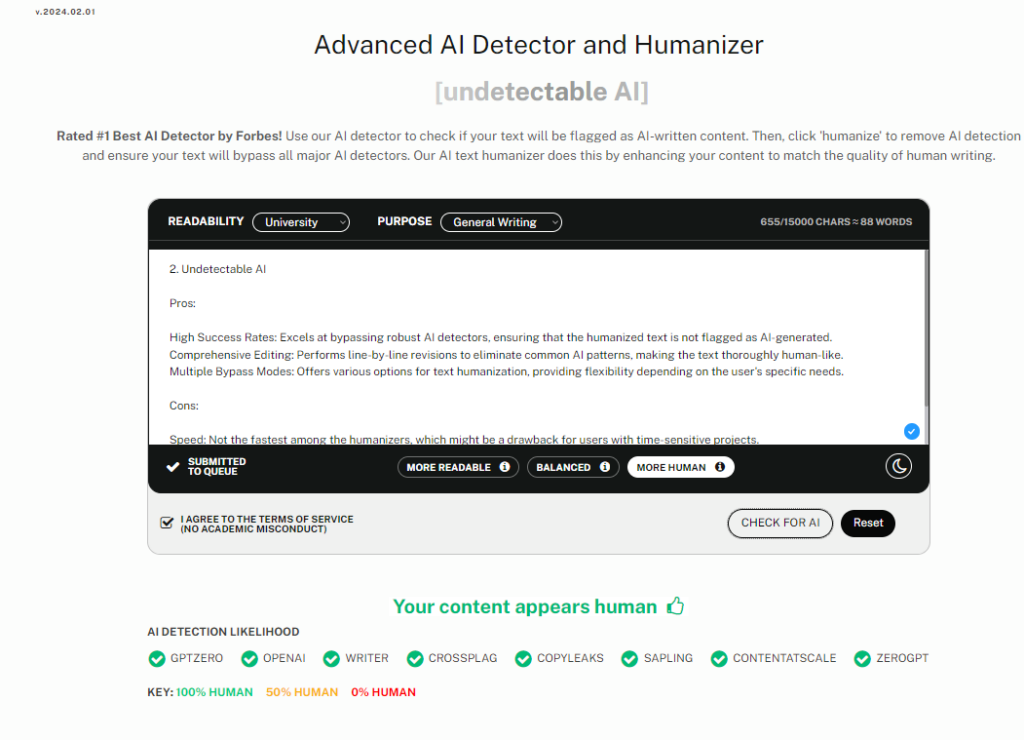

Wenn es darum geht, KI-generierte Inhalte aufzuspüren, gehören KI-Detektoren logischerweise zu den wichtigsten verfügbaren Tools. Sich jedoch bei der Überprüfung von Inhalten ausschließlich auf Tools wie Originality.AI, CopyLeaks und ähnliche zu verlassen, hat gravierende Grenzen:

- Diese Detektoren haben oft massive Probleme mit der Genauigkeit, wenn sie auf Inhalte stoßen, die absichtlich modifiziert wurden, um einer Erkennung zu entgehen. In einigen Tests ist die Genauigkeit bei der Erkennung von KI-generierten Inhalten auf bis zu 17,4 % abgestürzt – was alles andere als zuverlässig ist.

- Ein weiteres großes Problem bei KI-Detektoren ist ihre nachgewiesene Tendenz zur Voreingenommenheit (Bias). Forschungen haben klar gezeigt, dass Inhalte, die von Nicht-Muttersprachlern geschrieben wurden, sehr viel häufiger als KI-generiert markiert werden – selbst wenn sie komplett von Menschen verfasst wurden. Diese Voreingenommenheit kann zu unfairen Verurteilungen führen, besonders im akademischen oder beruflichen Umfeld.

- KI-Detektoren sind zudem in ihren endgültigen Urteilen oft ziemlich inkonsistent. Manchmal geben diese Tools eine „unsichere“ Rückmeldung, was bedeutet, dass sie nicht definitiv sagen können, ob der Inhalt menschlich oder KI-generiert ist. Diese Inkonsistenz führt sowohl zu falschen positiven als auch zu falschen negativen Ergebnissen, was das Vertrauen in diese Tools mindert.

- Zudem verlieren KI-Detektoren mit jedem Release neuer LLM-Versionen spürbar an Genauigkeit. Die rasante Weiterentwicklung von großen Sprachmodellen bedeutet schlicht, dass sich die Erkennungsmethoden ständig an die neuen Versionen anpassen müssen. Es gibt beispielsweise einen sehr deutlichen Unterschied in der Erkennungsgenauigkeit zwischen älteren Modellen wie GPT-3.5 und den fortschrittlicheren wie GPT-4o oder Claude 3.5.

- Darüber hinaus werden formellere und stark strukturierte Schreibstile grundsätzlich eher als KI-generiert markiert. Aus diesem simplen Grund raten einige Erkennungs-Tools, wie beispielsweise Originality.AI, ihren Nutzern ganz offiziell, sich eher auf informelle Schreibstile zu konzentrieren, um ärgerliche Fehlalarme zu vermeiden.

Kostenlose Prompts und Ebook zur Humanisierung Ihrer Texte

Jetzt herunterladen

Buchert Jean-marc

Bestätigter Experte für KI-Content-Prozesse. Mit seinen Methoden hat er seinen Kunden geholfen, LLM-basierten Content zu generieren, der ihren redaktionellen Standards und den Erwartungen ihres Publikums entspricht.

Alle Beiträge