Sommaire

Originality.ai est devenu un outil dont on parle beaucoup. Il promet de vous dire si un texte a été rédigé par une intelligence artificielle.

Mais il n’est pas parfait, et si vous ne comprenez pas son fonctionnement, vous risquez de surinterpréter les résultats.

Dans cet avis, nous allons voir de manière claire et pratique si Originality.ai mérite sa place dans votre flux de travail.

Testez Gratuitement la Détection Originality.AI Ici

Comment fonctionne l’algorithme de détection d’Originality.ai ?

Originality.ai décrit son approche en utilisant une structure de modèle inspirée d’architectures comme ELECTRA : un modèle générateur simule la création de texte, tandis qu’un modèle discriminateur apprend à distinguer ce texte généré d’un texte écrit par un humain.

- Ils commencent par rassembler des jeux de données massifs : des millions d’échantillons de textes humains issus de sources variées, et des millions d’échantillons générés par de multiples modèles d’IA.

- Le générateur produit des textes de style IA variés (en utilisant des techniques comme l’échantillonnage de noyau et la variation de température) pour créer des contenus plus furtifs ; le discriminateur est ensuite entraîné sur des paires « humain vs IA » pour apprendre à faire la différence.

- Le système est constamment affiné avec les nouveaux modèles qui sortent, évoluant ainsi au même rythme que l’écriture par IA.

Extraction de caractéristiques : analyse de texte et reconnaissance de motifs

Une fois le modèle entraîné, Originality.ai extrait les caractéristiques d’un texte soumis pour estimer la probabilité « généré par IA » vs « écrit par un humain ». Les signaux clés incluent :

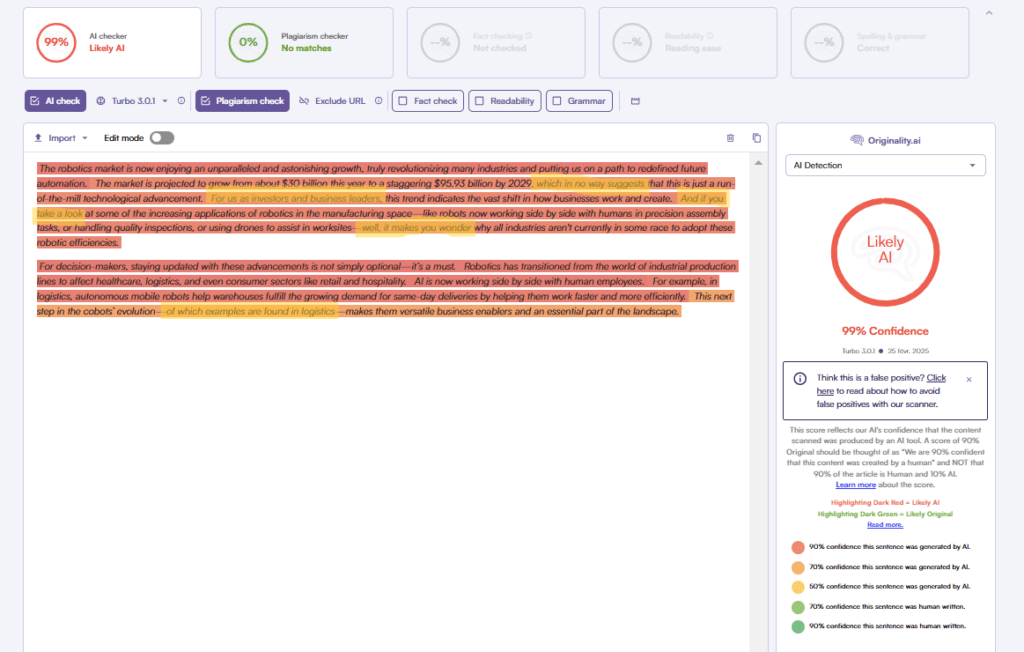

- Motifs au niveau des tokens et des phrases : Les textes générés par IA présentent souvent des longueurs de phrases plus uniformes, un vocabulaire cohérent et moins de tournures inhabituelles. Originality.ai utilise un surlignage « rouge foncé » pour marquer les segments à haut risque.

- Diversité lexicale et variation syntaxique : Les auteurs humains varient généralement la longueur des phrases, incluent des expressions familières ou de légères erreurs ; l’IA écrit souvent de manière « trop propre » ou « équilibrée ». Originality.ai recherche cette irrégularité (burstiness) ou son absence.

- Cohérence sémantique/structurelle : L’outil vérifie si le texte coule naturellement, utilise les transitions de manière humaine et est moins formulé. Plus il ressemble aux modèles IA connus, plus le score de « probabilité IA » est élevé.

- Robustesse aux signaux contradictoires : Le modèle est entraîné sur des textes paraphrasés, réécrits ou déguisés, ce qui lui permet de détecter du contenu IA modérément masqué — l’équipe affirme avoir intentionnellement construit son entraînement sur un « échantillonnage diversifié provenant de différents modèles et méthodes de génération ».

Précision d’Originality.ai sur le benchmark RAID

Si vous comptez payer pour un détecteur d’IA, il vous faut plus que des promesses marketing. C’est exactement ce que le benchmark RAID vous aide à comprendre concernant Originality.ai.

RAID (« Robust AI Detection ») est un vaste benchmark indépendant, construit par des chercheurs de Penn, UCL, King’s College London et CMU pour tester les limites des détecteurs d’IA. Il inclut :

- Plus de 6 millions de textes

- 11 LLMs différents (ChatGPT, GPT-4, Llama, etc.)

- 8 domaines (actualités, livres, résumés, Reddit, Wikipédia, etc.)

- 11 attaques contradictoires (paraphrase, fautes d’orthographe, astuces d’homoglyphes, etc.)

Taux de précision : à quelle fréquence Originality.ai repère-t-il l’IA ?

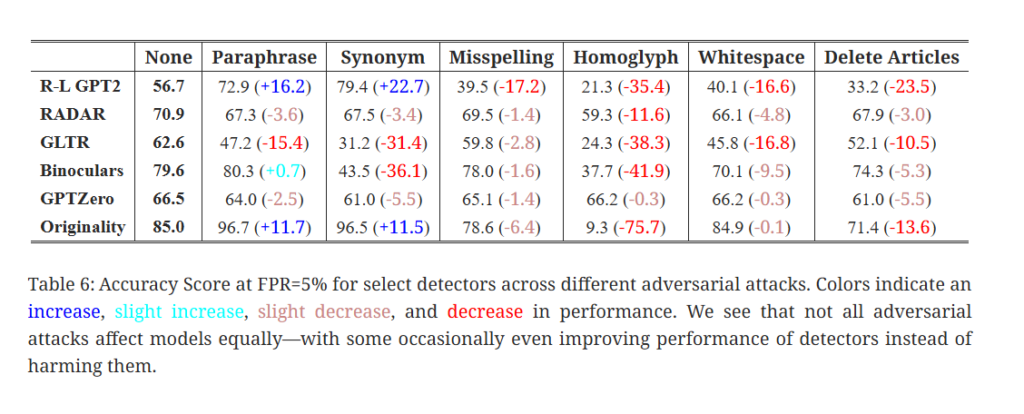

Sur RAID, le détecteur d’Originality.ai :

- Atteint ~85 % de précision sur le jeu de données de base (textes IA standards vs humains) avec un seuil de 5 % de faux positifs.

- Atteint ~96,7 % de précision sur le contenu IA paraphrasé, bien au-dessus de la moyenne des autres détecteurs (environ ~59 % selon une synthèse des résultats RAID).

- Affiche une moyenne globale de ~85 % sur l’ensemble des 11 modèles, ce qui était le score composite le plus élevé parmi les détecteurs évalués.

Robustesse face aux tentatives de contournement

RAID n’est pas juste un jeu de données « propre » ; il teste délibérément le comportement des détecteurs quand quelqu’un essaie de cacher l’usage de l’IA. Ici, Originality.ai s’en sort particulièrement bien :

- Il se classe 1er dans 9 des 11 tests d’attaques contradictoires, et 2ème dans un autre, selon le résumé d’Originality et les synthèses indépendantes (y compris notre revue Intellectualead).

- Sur les 8 domaines de contenu, il se classe 1er dans 5 d’entre eux.

- Sur le contenu paraphrasé, il maintient 96,7 % de précision, là où beaucoup d’autres détecteurs chutent brutalement.

Taux de faux positifs : accuse-t-il souvent les humains à tort ?

RAID normalise les détecteurs à un taux de faux positifs de 5 %, ce qui signifie que chaque outil est calibré pour qu’environ 1 texte humain sur 20 soit mal classé comme IA sur le benchmark.

D’autres travaux académiques évalués par des pairs ont trouvé des schémas similaires : une haute sensibilité (détecte la plupart des IA) avec des spécificités souvent autour de 95–98 %, ce qui correspond à 2–5 % de faux positifs selon le seuil choisi.

Tarifs d’Originality.ai

Originality.ai propose un mélange d’abonnements, de crédits à la demande et de niveaux entreprise. Cette flexibilité permet d’adapter le coût à votre usage réel et à la taille de votre équipe.

- Plan Abonnement (Pro) : Pour les utilisateurs individuels ou petites équipes vérifiant régulièrement, le plan Pro est affiché à 14,95 $ US/mois pour 2 000 crédits mensuels. En facturation annuelle, cela descend à 12,95 $ US/mois (≈ 155,40 $ US/an).

- Plan À la Carte (Pay-As-You-Go) : Pour les utilisateurs occasionnels, il existe un modèle basé uniquement sur les crédits. Une revue cite 0,01 $ US pour 100 mots — ce qui signifie que chaque crédit couvre 100 mots scannés pour l’IA ou le plagiat.

- Plan Entreprise : Pour les agences, grands éditeurs ou équipes nécessitant un accès API, des crédits en gros, des scans de sites entiers et la gestion d’équipe, Originality.ai propose un niveau Entreprise à 136,58 $ US/mois (facturé annuellement) couvrant 15 000 crédits/mois et toutes les fonctionnalités entreprise.

Que couvre un « Crédit » ?

- Avec l’abonnement, vous obtenez 2 000 crédits/mois. Un crédit équivaut généralement à 100 mots scannés par le système (détection IA ou plagiat).

- Si vous uploadez de longs documents (ex: 3 000 mots), vous utiliserez environ 30 crédits.

- En mode à la carte, vous achetez des crédits selon vos besoins — utile si vous ne faites des vérifications qu’occasionnellement. Une revue donne des exemples de packs : 2 000 crédits pour 20 $, 10 000 crédits pour 100 $, jusqu’à 50 000 crédits pour 500 $.

Originality.ai vaut-il vraiment le coup ?

Réponse courte : oui, si vous l’utilisez comme un assistant intelligent — et non comme un juge suprême.

Originality.ai peut véritablement vous aider de deux manières principales :

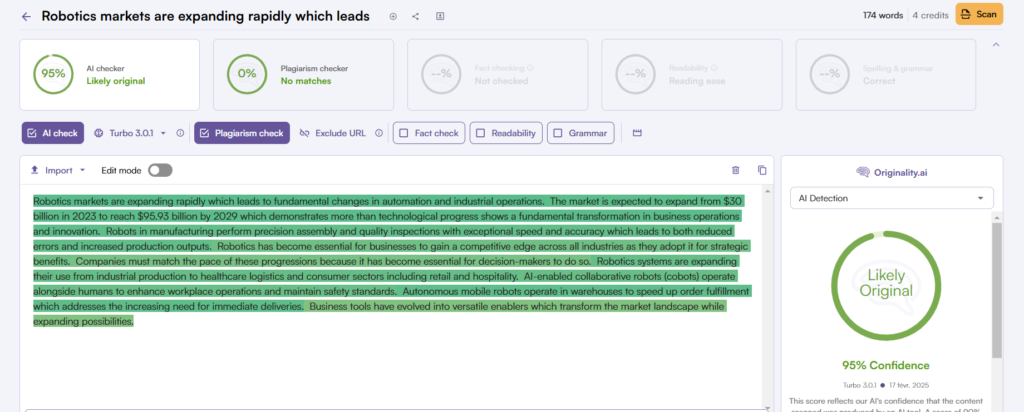

- Rendre votre propre contenu plus humain et digne de confiance.

- Vous donner des signaux indiquant que l’IA a probablement été utilisée dans un texte que vous révisez.

Voici ce qu’il peut faire de manière réaliste :

- Vous donner un score de probabilité qu’un texte soit généré par IA.

- Surligner des phrases ou sections spécifiques qui présentent des motifs typiques de l’IA.

- Combiner cela avec les résultats de plagiat pour montrer si quelqu’un a copié ou reformulé paresseusement du contenu existant.

C’est suffisant pour dire :

« Ce brouillon semble fortement généré par l’IA ; je devrais le relire plus attentivement, poser des questions, et peut-être demander une réécriture. »

Ce n’est pas suffisant pour dire :

« Parce qu’Originality.ai affiche 92 % d’IA, je peux prouver que tu as triché / menti / plagié. »

Même sur des benchmarks solides comme RAID, Originality.ai reste un modèle probabiliste : il peut être très bon, mais pas parfait. Cela signifie que :

- Certains textes assistés par IA passeront pour « humains ».

- Certains textes légitimement humains (surtout ceux très propres et bien structurés) peuvent occasionnellement être marqués comme IA.

Vous devez donc traiter les résultats comme :

- Des signaux, pas des verdicts.

- Une raison de creuser plus loin, pas une raison de lancer des accusations immédiates.

Prompts gratuits et Ebook pour humaniser votre texte

Télécharger Maintenant

Buchert Jean-marc

Expert confirmé en processus de contenu IA. Par ses méthodes, il a aidé ses clients à générer du contenu de qualité qui correspond à leurs exigences éditoriales et aux attentes de leur public.

Tous les Articles